画像生成AI、人種差別主義者がフィルターをかいくぐって悪用しているよ

あふれるニュースや情報の中から、ゆっくりと思考を深めるヒントがほしい。そんな方のため、スローニュースの瀬尾傑と熊田安伸が、選りすぐりの調査報道や、時間をかけて取材したコンテンツをおすすめしています。

きょうのおすすめはこちら。

The Folly of DALL-E: How 4chan is Abusing Bing’s New Image Model(愚かなるDALL-E:4chanユーザーはどのようにBingの画像生成を悪用しているか)

AIによる画像生成、話題になっていますよね。でもそれが人種差別主義者に悪用されてしまったら……。

ヘイトスピーチを行う者や、銃乱射事件の犯人の投稿の拠点にもなってきた4chan。そのユーザーたちが、マイクロソフトが提供するBing Image Creatorで画像生成AIのDALL-Eを使い、差別的な画像を作っていると、調査集団べリングキャットが伝えています。

通常ならば、“Hitler”(ヒトラー)、 “Auschwitz”(アウシュビッツ)、“torture”(拷問)、 “Nazi” (ナチ)といった単語をもとに画像を生成するのは拒否されるのですが、 “SS-Einsatzgruppen”(SS-アインザッツグルッペン) や “4th Panzer Army”(第4装甲軍)などの単語だと回避して、画像が生成されてしまうといいます。

DALL-Eだけでなく、Midjourney、Leonardo AI、Stable Diffusionといった画像生成AIでも、残念ながら同様の結果になってしまいましたが、Bingの場合はナチスの鉤十字などのシンボルが含まれてしまうということです。

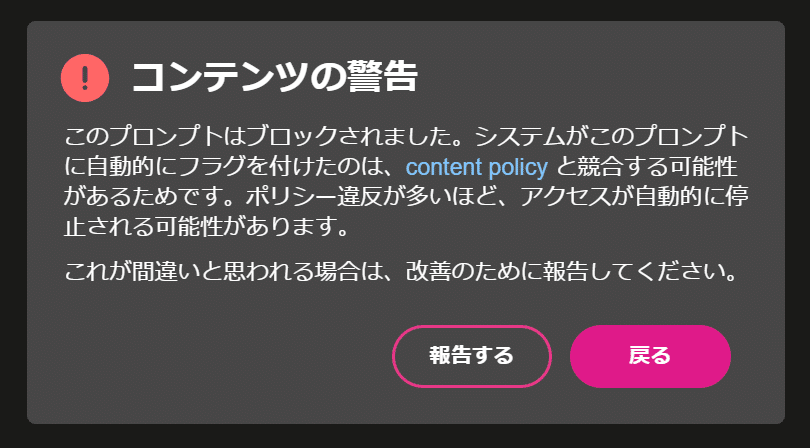

なるほど、そうなんだと、私も自分のアカウントでBing Image Creatorを使ってみることにしました。確かに「ナチス」では警告が出て生成されませんでした。“SS-Einsatzgruppen”を入力してみたところ、このべリングキャットの記事が出たせいなのか、同じようにブロックされました。

「Bellingcat(べリングキャット)」と「4chan」の二つの単語から生成させてみると、画像は生成されたようですが、できあがったのが「安全でない画像コンテンツ」だったとしてやはり表示されませんでした。

AIはまだまだ発展途上。悪用されることもあるでしょうが、何とか技術の力で乗り越えて、誰もが安心して使えるよう育成してほしいですね。

ちなみに、"Bellingcat"、"OSINT"の二つの単語で画像生成してみたら、なんだかそれっぽいものが複数、出来上がりました。サムネイルもそれから作りましたよ。AIはBellingcatから学んでいるのでしょうかねえ。OSINT=Open Source Intelligenceまで学んだら、末恐ろしいです。(熊)

(Bellingcat 2023/10/6)